Как настроить модель искусственного интеллекта в чат-боте

Используйте модель искусственного интеллекта от OpenAI, DeepSeek и Claude в чат-боте, чтобы генерировать ответы в зависимости от запроса пользователя и контекста диалога.

Например, ИИ может создавать тексты на основе инструкции, искать актуальную информацию онлайн или отвечать с учетом контекста предыдущего диалога и вашей инструкции. Вы можете управлять параметрами генерации, чтобы настроить стиль и точность ответов.

Рассмотрим, как выбрать модель, настроить контекст, токены и температуру.

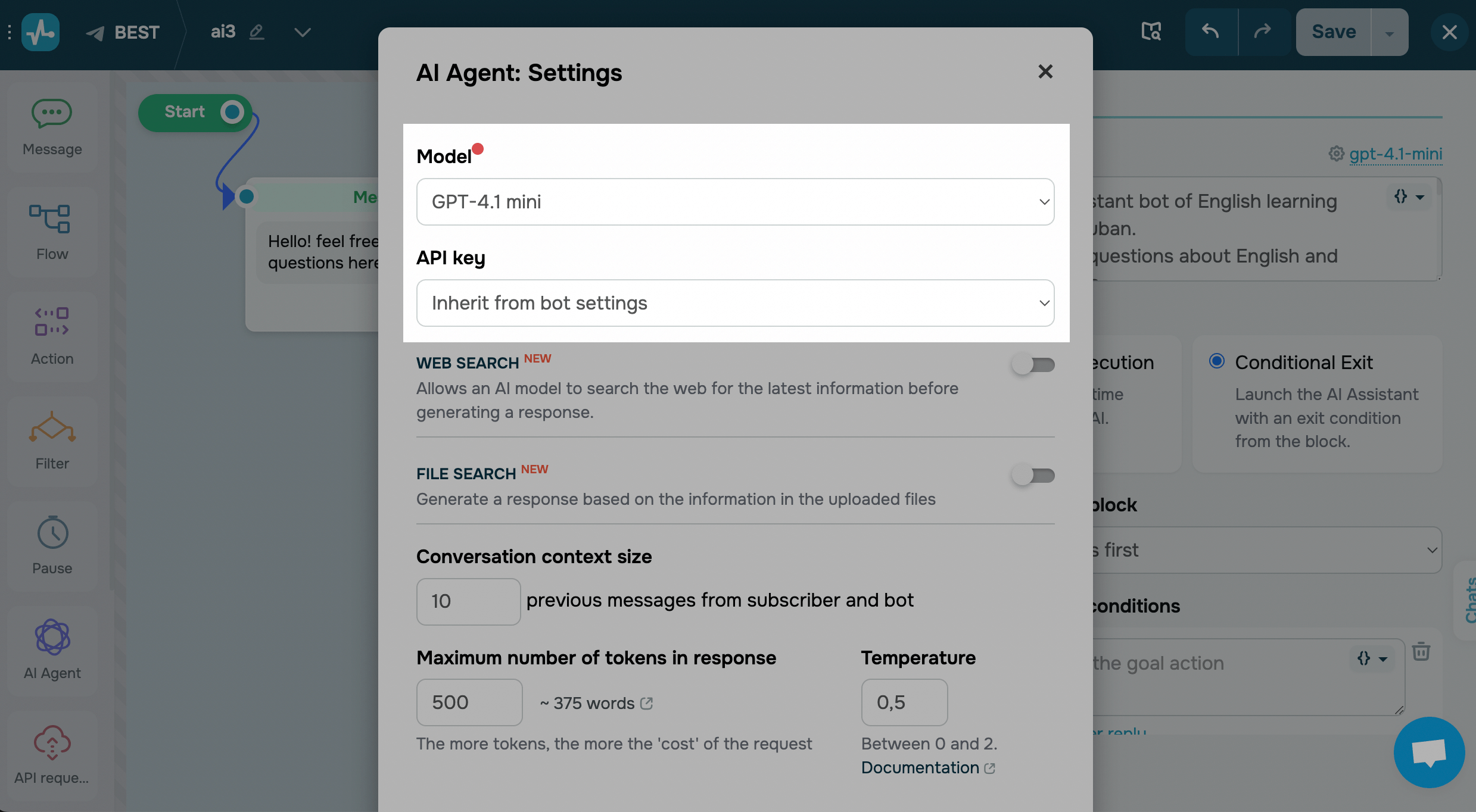

В конструкторе цепочки чат-ботов выберите элемент ИИ агент, нажмите на название модели в правом верхнем углу и заполните поля.

Подключите модель

В Модель выберите, какую модель ИИ использовать для генерации ответов.

В Ключ API выберите, как авторизовать запросы: наследовать токен из настроек или использовать отдельный токен для этого бота.

Читайте также: Как подключить ChatGPT от OpenAI к чат-боту, Как подключить DeepSeek для интеграции с сервисами SendPulse, Как подключить Anthropic Claude для интеграции с сервисами SendPulse.

Настройте модель

В зависимости от выбранной модели ИИ настройки могут отличаться.

Использование дополнительных параметров тарифицируется согласно тарифам провайдера ИИ. Читайте подробнее: OpenAI API Pricing, Anthropic API Pricing.

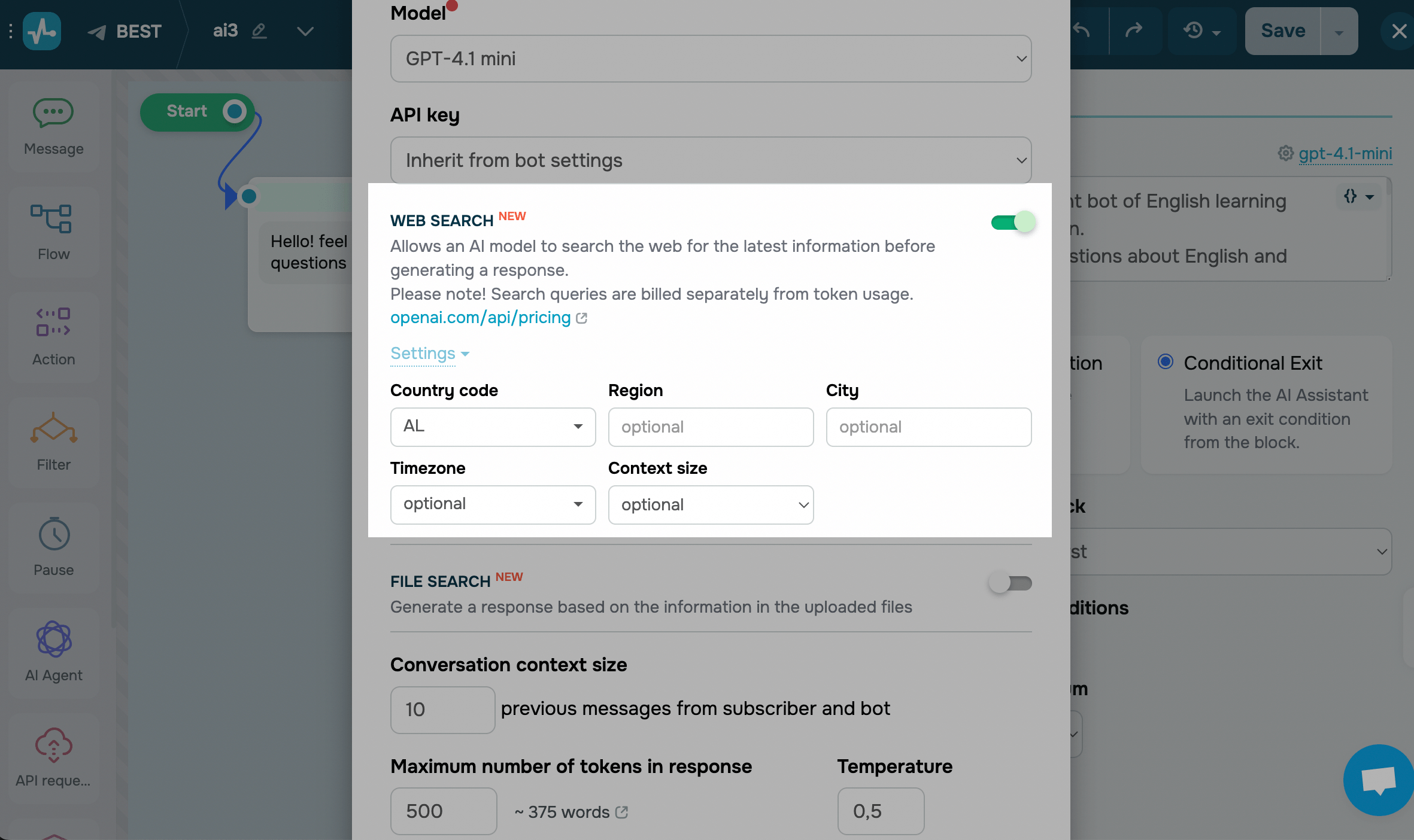

Подключите веб-поиск

Активируйте веб-поиск, чтобы ИИ-модель искала самую актуальную информацию в интернете перед формированием ответа. Поиск происходит только тогда, когда модель определяет, что не сможет дать исчерпывающий ответ без актуальных данных из интернета.

Дополнительно в Anthropic модели можно указать домен и часовой пояс, а для других моделей — страну, регион или город для более точного поиска.

Если веб-поиск отключен, модель будет использовать только информацию из вашей инструкции, контекста и данных на момент её обучения.

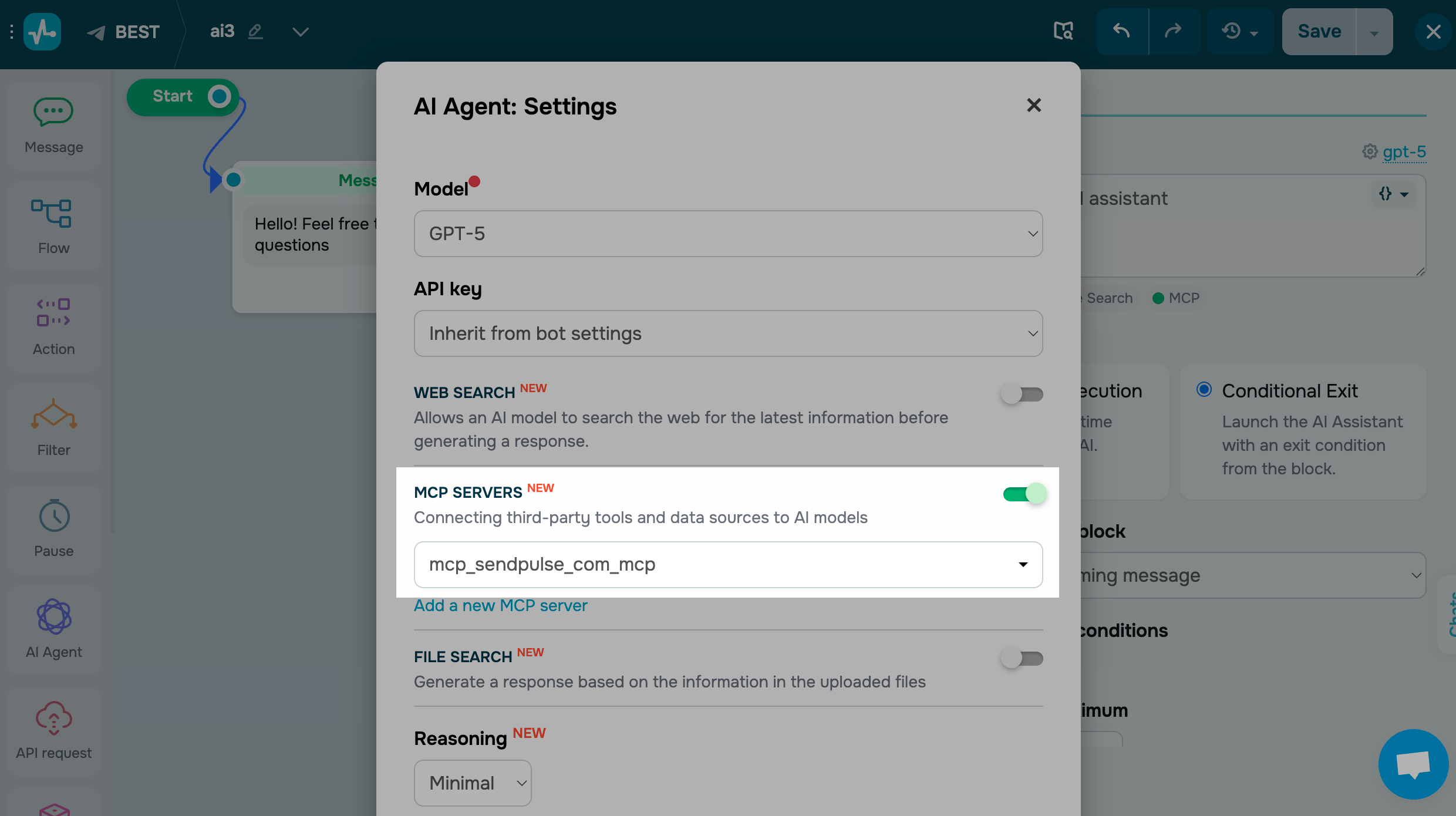

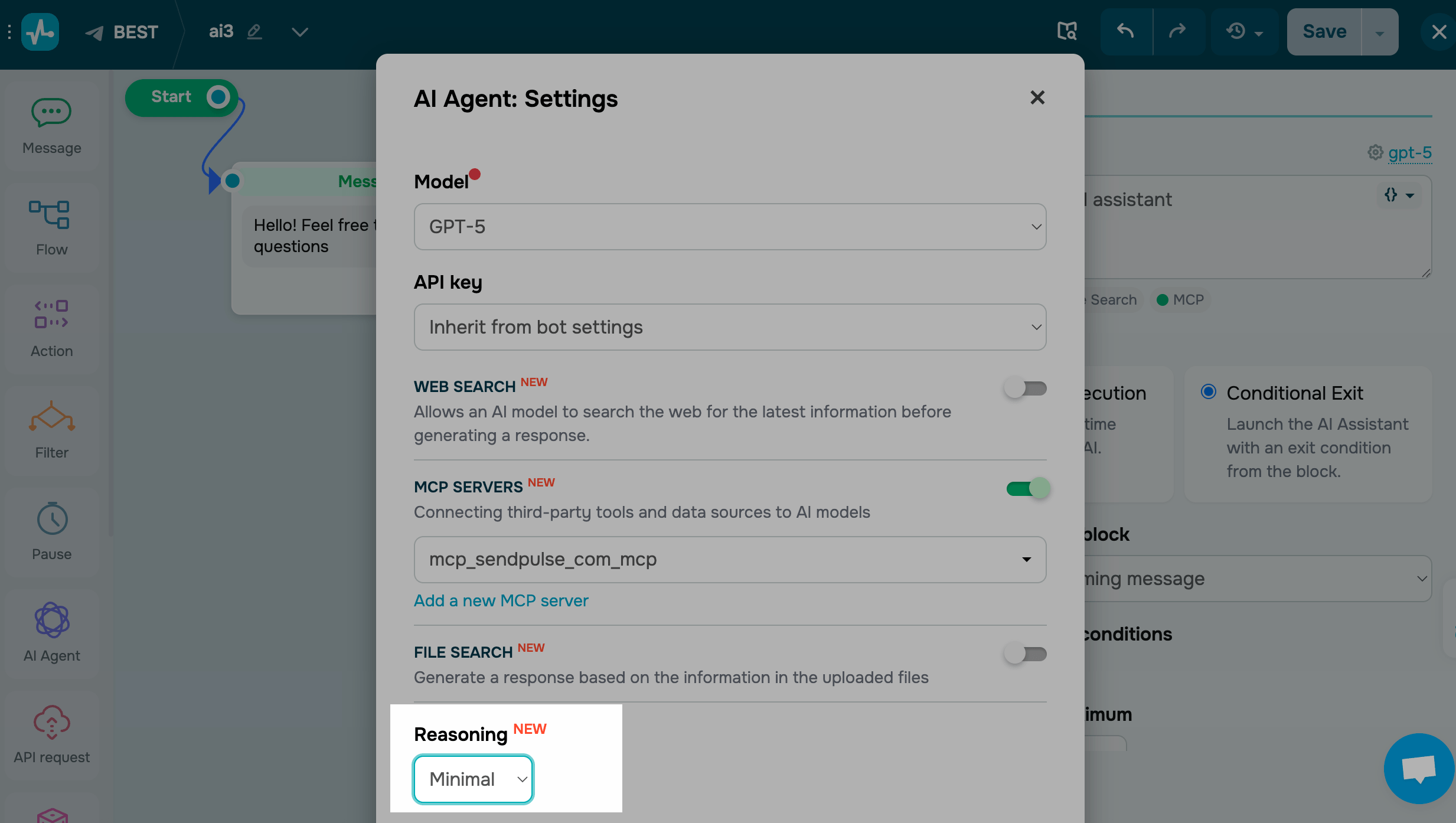

Подключите MCP сервер

Активируйте MCP servers, чтобы добавить подключение к удаленному MCP серверу. Выберите из списка подключения, которые вы предварительно добавили в настройках бота.

Запросы к MCP серверам не тарифицируются, в отличие от веб- или файлового поиска. Однако чем больше инструментов вы подключаете, тем больше дополнительных данных передается вместе с каждым запросом к ИИ, а значит — увеличивается расход токенов.

После добавления MCP сервера модель сможет выполнять действия, определенные MCP инструментами, например получение каталога, отправку сообщений, создание заказов и другие.

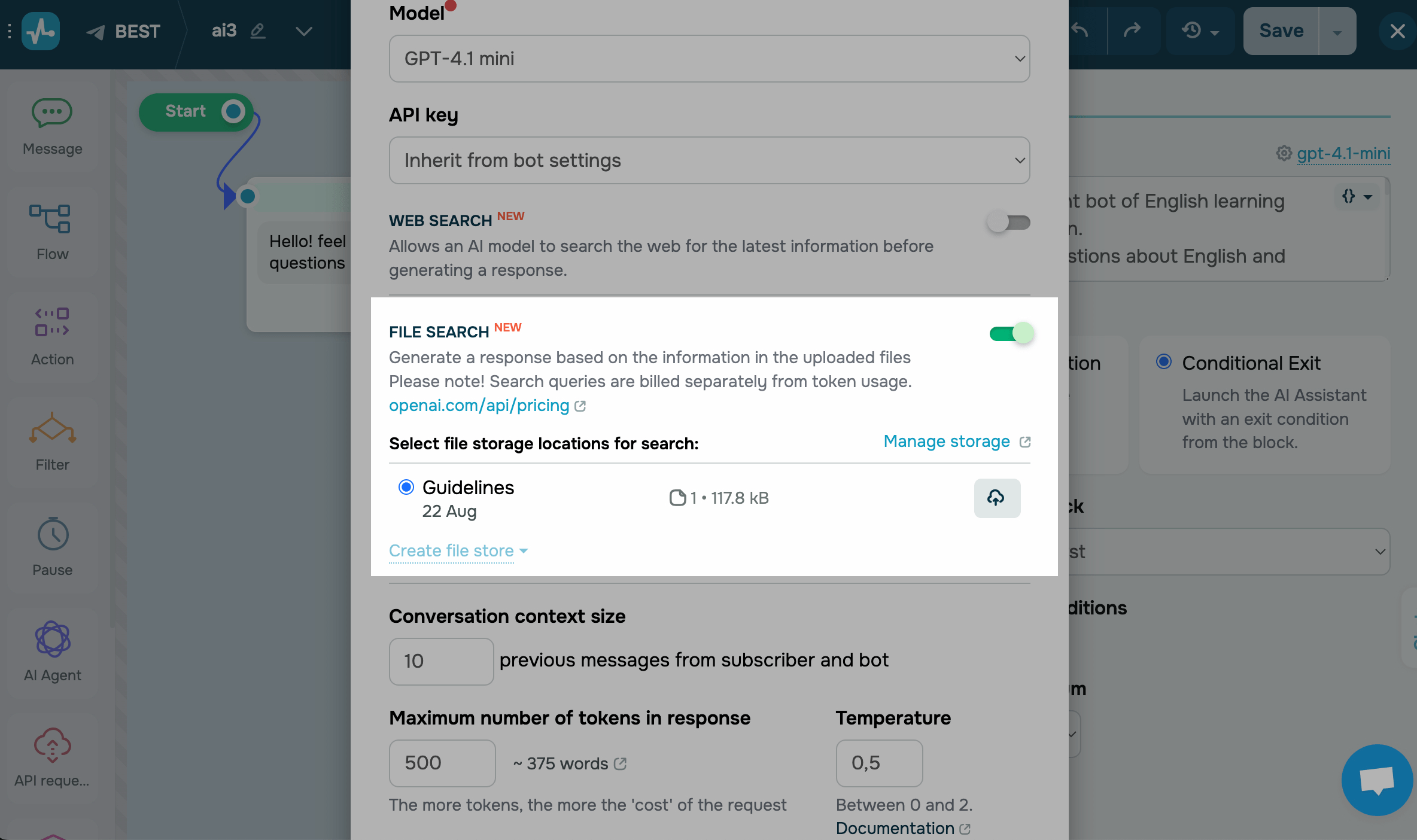

Подключите поиск по файлам

Активируйте поиск по файлам, чтобы ИИ-модель формировала ответ на основе информации в загруженных файлах.

Например, если в архиве хранятся прайс-листы, остатки товаров или договоры, модель сможет находить актуальные значения по запросу — проверить наличие товара или извлечь данные из конкретного пункта соглашения.

После активации выберите хранилище файлов для поиска из своего хранилища в вашем аккаунте OpenAI. В одном хранилище вы можете сохранять несколько файлов.

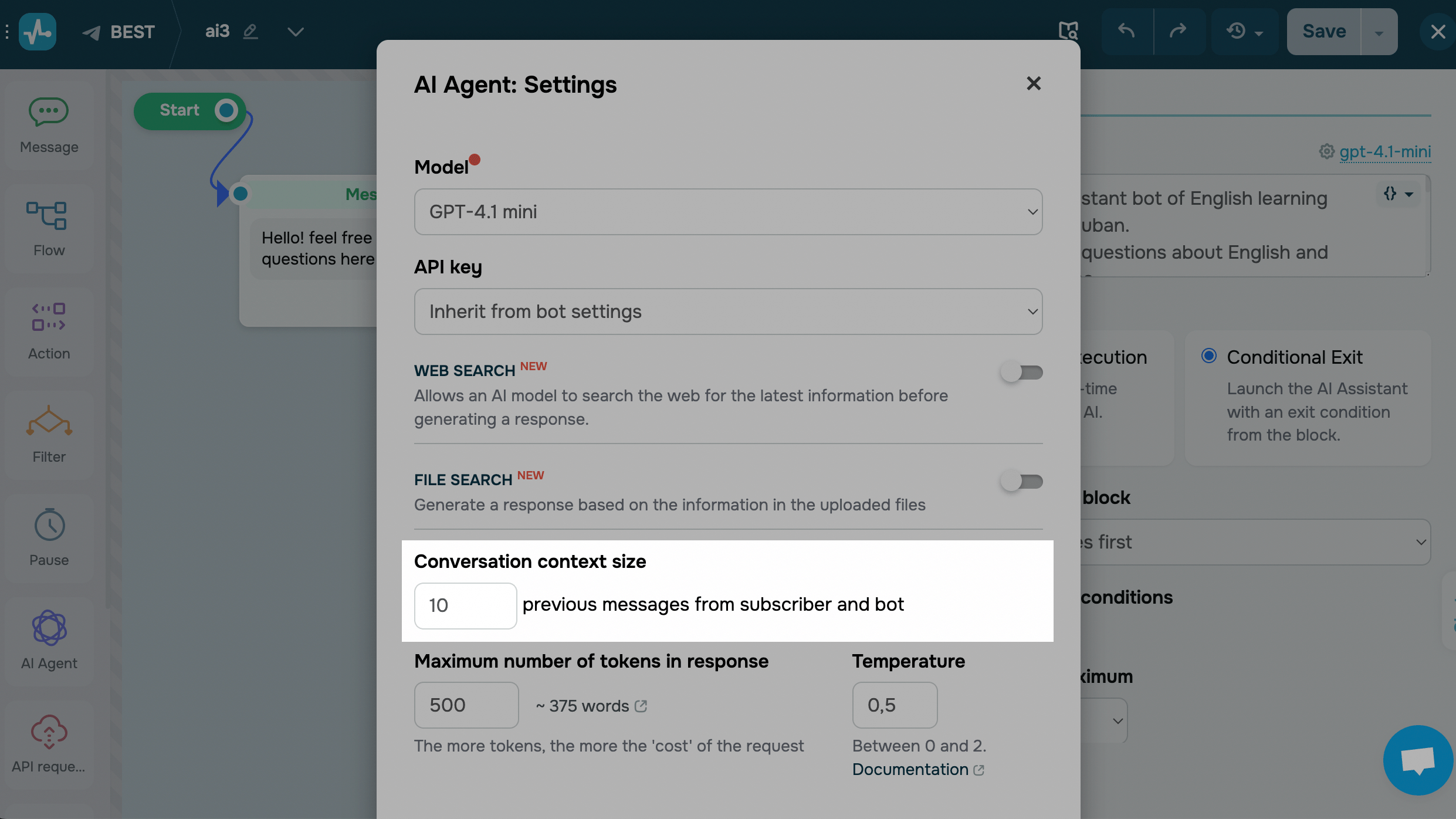

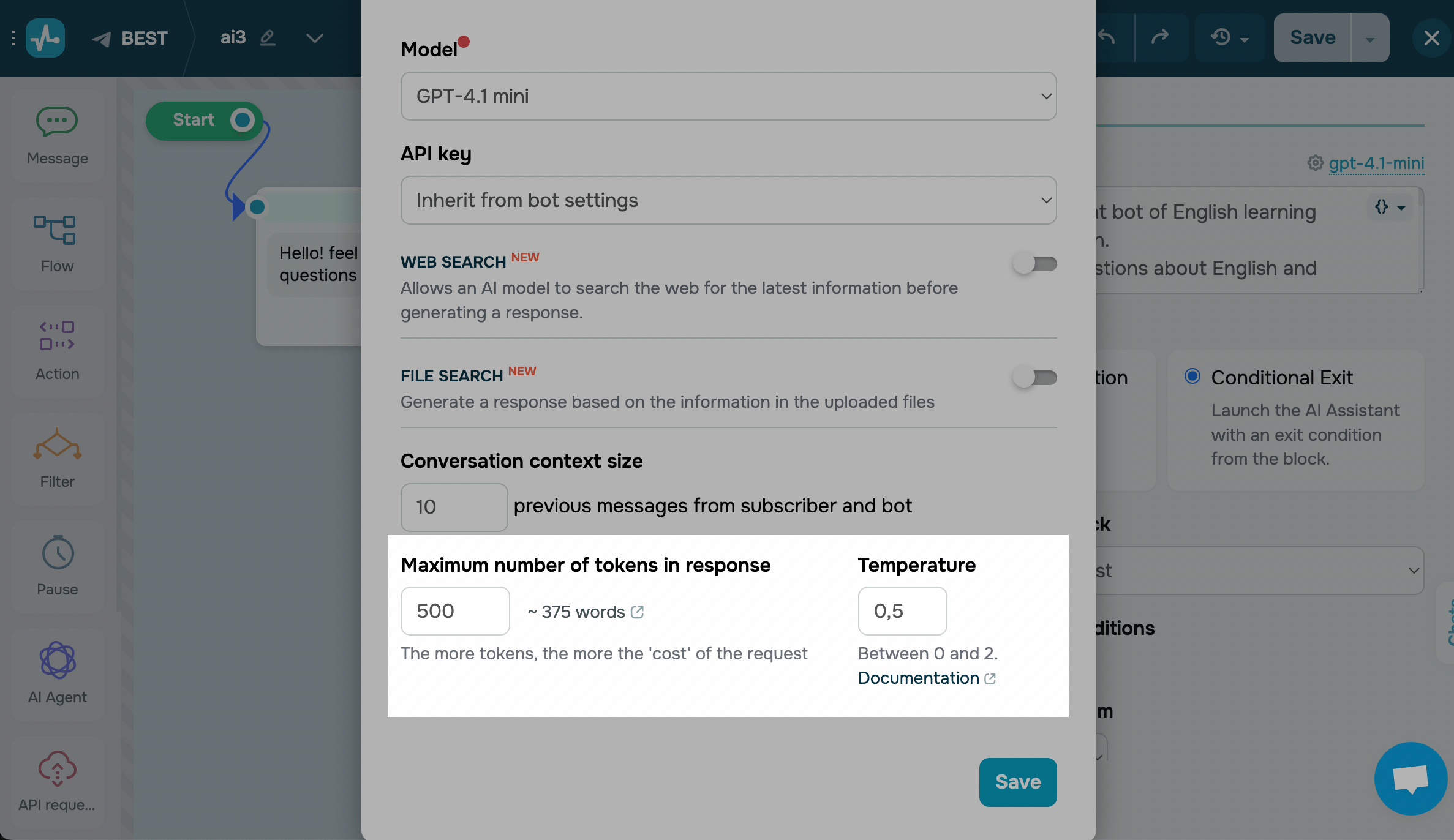

Установите объем контекста переписки

В поле Объем контекста переписки укажите, сколько последних сообщений подписчика и бота добавить в запрос к ИИ как контекст переписки.

Настройте дополнительные параметры

Для некоторых моделей вы можете указать дополнительные параметры, чтобы управлять длиной и вариативностью ответов.

Для моделей семейства GPT-5-* доступна опция Reasoning, которая определяет уровень «глубины размышлений» модели перед формированием ответа.

Выберите один из уровней:

| Minimal | Самый быстрый ответ, минимальные затраты токенов. |

| Low | Базовый уровень аналитики, оптимален для большинства запросов. |

| Medium | Более глубокая обработка запроса, ответы точнее, но медленнее. |

| High | Максимальная глубина рассуждений, наибольшие затраты токенов и время генерации. |

При использовании любых инструментов (MCP, веб-поиск, файл-поиск) минимально допустимый уровень Reasoning — Low.

В поле Максимальное количество токенов в ответе (Maximum number of tokens in response) укажите количество.

Токен — часть слова, которая используется для обработки естественного языка. Для английского текста 1 токен — это примерно 4 символа или 0,75 слова. Для других языков и более точного расчета вы можете воспользоваться калькулятором от OpenAI.

В Температура выберите показатель от 0 до 2.

Температура — это параметр, который влияет на абстрактность ответов. Например, если задать один и тот же вопрос, то выходные данные будут разными в зависимости от выбранной температуры — абстрактные или более точные.

Более высокие значения ближе к 2, например, 1.3, сделают ответы более случайными. Более низкие значения ближе к 0, например, 0.2, сделают их более исчерпывающими, но одинаковыми по смыслу.

После заполнения полей нажмите Сохранить.

Обновлено: 18.11.2025

или